Что влияет на приведенную погрешность прибора

Погрешности измерения датчиков КИП. Классы точности

Основной качественной характеристикой любого датчика КИП является погрешность измерения контролируемого параметра. Погрешность измерения прибора это величина расхождения между тем, что показал (измерил) датчик КИП и тем, что есть на самом деле. Погрешность измерения для каждого конкретного типа датчика указывается в сопроводительной документации (паспорт, инструкция по эксплуатации, методика поверки), которая поставляется вместе с данным датчиком.

По форме представления погрешности делятся на абсолютную, относительную и приведенную погрешности.

| ООП | основная относительная погрешность |

| ОПП | основная приведенная погрешность |

| ОАП | основная абсолютная погрешность |

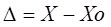

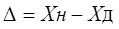

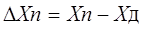

Абсолютная погрешность – это разница между измеренной датчиком величиной Хизм и действительным значением Хд этой величины.

Действительное значение Хд измеряемой величины это найденное экспериментально значение измеряемой величины максимально близкое к ее истинному значению. Говоря простым языком действительное значение Хд это значение, измеренное эталонным прибором, или сгенерированное калибратором или задатчиком высокого класса точности. Абсолютная погрешность выражается в тех же единицах измерения, что и измеряемая величина (например, в м3/ч, мА, МПа и т.п.). Так как измеренная величина может оказаться как больше, так и меньше ее действительного значения, то погрешность измерения может быть как со знаком плюс (показания прибора завышены), так и со знаком минус (прибор занижает).

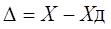

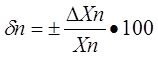

Относительная погрешность – это отношение абсолютной погрешности измерения Δ к действительному значению Хд измеряемой величины.

Относительная погрешность выражается в процентах, либо является безразмерной величиной, а также может принимать как положительные, так и отрицательные значения.

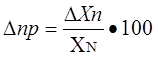

Приведенная погрешность – это отношение абсолютной погрешности измерения Δ к нормирующему значению Хn, постоянному во всем диапазоне измерения или его части.

Нормирующее значение Хn зависит от типа шкалы датчика КИП:

Приведенная погрешность выражается в процентах, либо является безразмерной величиной, а также может принимать как положительные, так и отрицательные значения.

Довольно часто в описании на тот или иной датчик указывается не только диапазон измерения, например, от 0 до 50 мг/м3, но и диапазон показаний, например, от 0 до 100 мг/м3. Приведенная погрешность в этом случае нормируется к концу диапазона измерения, то есть к 50 мг/м3, а в диапазоне показаний от 50 до 100 мг/м3 погрешность измерения датчика не определена вовсе – фактически датчик может показать все что угодно и иметь любую погрешность измерения. Диапазон измерения датчика может быть разбит на несколько измерительных поддиапазонов, для каждого из которых может быть определена своя погрешность как по величине, так и по форме представления. При этом при поверке таких датчиков для каждого поддиапазона могут применяться свои образцовые средства измерения, перечень которых указан в методике поверки на данный прибор.

У некоторых приборов в паспортах вместо погрешности измерения указывают класс точности. К таким приборам относятся механические манометры, показывающие биметаллические термометры, термостаты, указатели расхода, стрелочные амперметры и вольтметры для щитового монтажа и т.п. Класс точности – это обобщенная характеристика средств измерений, определяемая пределами допускаемых основных и дополнительных погрешностей, а также рядом других свойств, влияющих на точность осуществляемых с их помощью измерений. При этом класс точности не является непосредственной характеристикой точности измерений, выполняемых этим прибором, он лишь указывает на возможную инструментальную составляющую погрешности измерения. Класс точности прибора наноситься на его шкалу или корпус по ГОСТ 8.401-80.

Определение погрешности измерения датчиков выполняют, например, при их периодической поверке и калибровке. С помощью различных задатчиков и калибраторов с высокой точностью генерируют определенные значения той или иной физической величины и сличают показания поверяемого датчика с показаниями образцового средства измерения, на которое подается то же самое значение физической величины. Причем погрешность измерения датчика контролируется как при прямом ходе (увеличение измеряемой физической величины от минимума до максимума шкалы), так и при обратном ходе (уменьшение измеряемой величины от максимума до минимума шкалы). Это связано с тем, что из-за упругих свойств чувствительного элемента датчика (мембрана датчика давления), различной интенсивности протекания химических реакций (электрохимический сенсор), тепловой инерции и т.п. показания датчика будут различны в зависимости от того, как меняется воздействующая на датчик физическая величина: уменьшается или увеличивается.

Довольно часто в соответствии с методикой поверки отсчет показаний датчика при поверке нужно выполнять не по его дисплею или шкале, а по величине выходного сигнала, например, по величине выходного тока токового выхода 4…20 мА.

У поверяемого датчика давления со шкалой измерения от 0 до 250 mbar основная относительная погрешность измерения во всем диапазоне измерений равна 5%. Датчик имеет токовый выход 4…20 мА. На датчик калибратором подано давление 125 mbar, при этом его выходной сигнал равен 12,62 мА. Необходимо определить укладываются ли показания датчика в допустимые пределы.

Во-первых, необходимо вычислить каким должен быть выходной ток датчика Iвых.т при давлении Рт = 125 mbar.

Iвых.т = Iш.вых.мин + ((Iш.вых.макс – Iш.вых.мин)/(Рш.макс – Рш.мин))*Рт

где Iвых.т – выходной ток датчика при заданном давлении 125 mbar, мА.

Iш.вых.мин – минимальный выходной ток датчика, мА. Для датчика с выходом 4…20 мА Iш.вых.мин = 4 мА, для датчика с выходом 0…5 или 0…20 мА Iш.вых.мин = 0.

Рш.макс – максимум шкалы датчика давления, mbar. Рш.макс = 250 mbar.

Рш.мин – минимум шкалы датчика давления, mbar. Рш.мин = 0 mbar.

Рт – поданное с калибратора на датчик давление, mbar. Рт = 125 mbar.

Подставив известные значения получим:

То есть при поданном на датчик давлении равном 125 mbar на его токовом выходе должно быть 12 мА. Считаем, в каких пределах может изменяться расчетное значение выходного тока, учитывая, что основная относительная погрешность измерения равна ± 5%.

То есть при поданном на датчик давлении равном 125 mbar на его токовом выходе выходной сигнал должен быть в пределах от 11,40 до 12,60 мА. По условию задачи мы имеем выходной сигнал 12,62 мА, значит наш датчик не уложился в определенную производителем погрешность измерения и требует настройки.

Основная относительная погрешность измерения нашего датчика равна:

Поверка и калибровка приборов КИП должна выполнятся при нормальных условиях окружающей среды по атмосферному давлению, влажности и температуре и при номинальном напряжении питания датчика, так как более высокие или низкие температура и напряжение питания могут привезти к появлению дополнительной погрешности измерения. Условия проведения поверки указываются в методике поверки. Приборы, погрешность измерения которых не уложилась в установленные методикой поверки рамки либо заново регулируют и настраивают, после чего они повторно проходят поверку, либо, если настройка не принесла результатов, например, из-за старения или чрезмерной деформации сенсора, ремонтируются. Если ремонт невозможен то приборы бракуются и выводятся из эксплуатации.

Если все же приборы удалось отремонтировать то они подвергаются уже не периодической, а первичной поверке с выполнением всех изложенных в методике поверки пунктов для данного вида поверки. В некоторых случаях прибор специально подвергают незначительному ремонту (с отметкой в паспорте) так как по методике поверки выполнить первичную поверку оказывается существенно легче и дешевле чем периодическую, из-за различий в наборе образцовых средств измерения, которые используются при периодической и первичной поверках.

Для закрепления и проверки полученных знаний рекомендую выполнить тестовое задание.

Приведённая погрешности

По методам измерений

В 1960 г. на XI Генеральной конференции по мерам и весам была утверждена Международная система единиц (СИ).

В основе Международной системы единиц лежат семь единиц, охватывающих следующие области науки: механику, электричество, теплоту, оптику, молекулярную физику, термодинамику и химию:

· единица длины (механика) – метр;

· единица массы (механика) – килограмм;

· единица времени (механика) – секунда;

· единица силы электрического тока (электричество) – ампер;

· единица термодинамической температуры (теплота) – кельвин;

· единица силы света (оптика) – кандела;

· единица количества вещества (молекулярная физика, термодинамика и химия) – моль.

В Международной системе единиц есть дополнительные единицы:

· единица измерения плоского угла – радиан;

· единица измерения телесного угла – стерадиан.Таким образом, посредством принятия Международной системы единиц были упорядочены и приведены к одному виду единицы измерения физических величин во всех областях науки и техники, так как все остальные единицы выражаются через семь основных и две дополнительных единицы СИ. Например, количество электричества выражается через секунды и амперы.

2.Погрешности средств измерений. Абсолютная, относительная,

Погрешности средств измерений, отклонения метрологических свойств или параметров средств измерений от номинальных, влияющие на погрешности результатов измерений, получаемых при помощи этих средств. Составляющие этих погрешностей, зависящие от П. с. и., называются инструментальными погрешностями (инструментальными ошибками). П. с. и. выражают в форме абсолютных, относительных или приведённых погрешностей (т. е. соответственно в единицах измеряемой величины, в долях или процентах от неё либо в процентах от верхнего предела измерений, диапазона измерений или длины шкалы).

П. с. и., имеющие место при нормальных условиях применения средств измерений, называют основными; погрешности, вызванные отклонением значений влияющих величин (температуры, частоты электрического тока и т.п.) от принятых за нормальные, — дополнительными. Для каждого типа средств измерений устанавливаются пределы допускаемых погрешностей, определяющие классы точности средств измерений. При измерениях постоянных величин, когда используются установившиеся показания средств измерений, на результаты влияют только статические П. с. и. При измерениях изменяющихся величин к статическим добавляются динамические П. с. и. и общая погрешность возрастает.

По своему характеру П. с. и. бывают систематические, т. е. сохраняющиеся постоянными или закономерно изменяющиеся, и случайные, т. е. изменяющиеся случайным образом. Так, неправильно нанесённые отметки на шкале прибора или неточная подгонка мер (например, гирь) вызывают систематические погрешности; трение подвижных частей прибора — случайные. Систематические П. с. и. можно исключать введением поправок или умножением показаний на поправочные множители.

3.Класс точности прибора

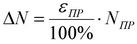

| (1) |

Приведенная погрешность прибора является по существу относительной погрешностью. По приведенной погрешности приборы делятся на:

Класс точности прибора указан на шкале прибора

Абсолютная погрешность, которую дает прибор, определяется из выражения (1):

|

NПР — предельное значение измеряемой величины по шкале прибора.

Если на шкале класс точности не обозначен, то абсолютная погрешность прибора принимается равной половине цены деления наименьшего значения шкалы прибора.

Погрешности приборов не зависят от числа измерений, они зависят от конструкции прибора. Для более точных измерений либо подбирают приборы более высокого класса точности, либо используют лабораторные методы измерений.

При лабораторных методах измерение производят n раз и получают n приближенных значений: N1, N2, N3. Nn.

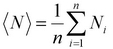

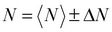

Среднее арифметическое найденных значений принимается за наиболее достоверное значение измеряемой величины

|

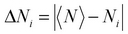

Абсолютная разность между средним значением и значением отдельного измерения называется абсолютной погрешностью этого измерения:

|

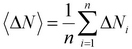

Средней абсолютной погрешностью n измерений называется среднее значение абсолютных погрешностей:

|

Истинное значение измеряемой величины будет:

| (2) |

Знаки «+» и «-» в выражении (2) означают, что погрешность может быть допущена как в сторону увеличения от действительного значения измеряемой величины, так и в сторону уменьшения.

Относительная погрешность представляет собой отношение средней абсолютной погрешности DN к среднему значению измеряемой величины и выражается обычно в процентах:

|

Расшифровка обозначений классов точности на средствах измерений

Нам важно ваше мнение! Был ли полезен опубликованный материал? Да | Нет

Погрешность измерений

Неотъемлемой частью любого измерения является погрешность измерений. С развитием приборостроения и методик измерений человечество стремиться снизить влияние данного явления на конечный результат измерений. Предлагаю более детально разобраться в вопросе, что же это такое погрешность измерений.

Погрешность измерения – это отклонение результата измерения от истинного значения измеряемой величины. Погрешность измерений представляет собой сумму погрешностей, каждая из которых имеет свою причину.

По форме числового выражения погрешности измерений подразделяются на абсолютные и относительные

Абсолютная погрешность – это погрешность, выраженная в единицах измеряемой величины. Она определяется выражением.

Поскольку истинное значение измеряемой величины остается неизвестным, на практике пользуются лишь приближенной оценкой абсолютной погрешности измерения, определяемой выражением

Относительная погрешность – это отношение абсолютной погрешности измерения к действительному значению измеряемой величины:

По закономерности появления погрешности измерения подразделяются на систематические, прогрессирующие, и случайные .

Систематическая погрешность – это погрешность измерения, остающаяся постоянной или закономерно изменяющейся при повторных измерениях одной и той же величины.

Прогрессирующая погрешность – это непредсказуемая погрешность, медленно меняющаяся во времени.

Систематические и прогрессирующие погрешности средств измерений вызываются:

Систематическая погрешность остается постоянной или закономерно изменяющейся при многократных измерениях одной и той же величины. Особенность систематической погрешности состоит в том, что она может быть полностью устранена введением поправок. Особенностью прогрессирующих погрешностей является то, что они могут быть скорректированы только в данный момент времени. Они требуют непрерывной коррекции.

Случайная погрешность – это погрешность измерения изменяется случайным образом. При повторных измерениях одной и той же величины. Случайные погрешности можно обнаружить только при многократных измерениях. В отличии от систематических погрешностей случайные нельзя устранить из результатов измерений.

По происхождению различают инструментальные и методические погрешности средств измерений.

Инструментальные погрешности — это погрешности, вызываемые особенностями свойств средств измерений. Они возникают вследствие недостаточно высокого качества элементов средств измерений. К данным погрешностям можно отнести изготовление и сборку элементов средств измерений; погрешности из-за трения в механизме прибора, недостаточной жесткости его элементов и деталей и др. Подчеркнем, что инструментальная погрешность индивидуальна для каждого средства измерений.

Методическая погрешность — это погрешность средства измерения, возникающая из-за несовершенства метода измерения, неточности соотношения, используемого для оценки измеряемой величины.

Погрешности средств измерений.

Абсолютная погрешность меры – это разность между номинальным ее значением и истинным (действительным) значением воспроизводимой ею величины:

Абсолютная погрешность измерительного прибора – это разность между показанием прибора и истинным (действительным) значением измеряемой величины:

Относительная погрешность меры или измерительного прибора – это отношение абсолютной погрешности меры или измерительного прибора к истинному

(действительному) значению воспроизводимой или измеряемой величины. Относительная погрешность меры или измерительного прибора может быть выражена в ( % ).

Приведенная погрешность измерительного прибора – отношение погрешности измерительного прибора к нормирующему значению. Нормирующие значение XN – это условно принятое значение, равное или верхнему пределу измерений, или диапазону измерений, или длине шкалы. Приведенная погрешность обычно выражается в ( % ).

Основная – это погрешность средства измерений, используемого в нормальных условиях, которые обычно определены в нормативно-технических документах на данное средство измерений.

Дополнительная – это изменение погрешности средства измерений вследствии отклонения влияющих величин от нормальных значений.

Статическая – это погрешность средства измерений, используемого для измерения постоянной величины. Если измеряемая величина является функцией времени, то вследствие инерционности средств измерений возникает составляющая общей погрешности, называется динамической погрешностью средств измерений.

Также существуют систематические и случайные погрешности средств измерений они аналогичны с такими же погрешностями измерений.

Факторы влияющие на погрешность измерений.

Погрешности возникают по разным причинам: это могут быть ошибки экспериментатора или ошибки из-за применения прибора не по назначению и т.д. Существует ряд понятий которые определяют факторы влияющие на погрешность измерений

Вариация показаний прибора – это наибольшая разность показаний полученных при прямом и обратном ходе при одном и том же действительном значении измеряемой величины и неизменных внешних условиях.

Класс точности прибора – это обобщенная характеристика средств измерений (прибора), определяемая пределами допускаемых основной и дополнительных погрешностей, а также другими свойствами средств измерений, влияющих на точность, значение которой устанавливаются на отдельные виды средств измерений.

Классы точности прибора устанавливают при выпуске, градуируя его по образцовому прибору в нормальных условиях.

Прецизионность — показывает, как точно или отчетливо можно произвести отсчет. Она определяется, тем насколько близки друг к другу результаты двух идентичных измерений.

Разрешение прибора — это наименьшее изменение измеряемого значения, на которое прибор будет реагировать.

Диапазон прибора — определяется минимальным и максимальным значением входного сигнала, для которого он предназначен.

Полоса пропускания прибора — это разность между минимальной и максимальной частотой, для которых он предназначен.

Чувствительность прибора — определяется, как отношение выходного сигнала или показания прибора к входному сигналу или измеряемой величине.

Шумы — любой сигнал не несущий полезной информации.